O que é Shadow AI e como gerenciar riscos ligados a IA

O uso de Inteligência Artificial (IA) nas empresas se popularizou muito nos últimos anos, justamente pelas possibilidades que essas ferramentas trazem: automatização de tarefas repetitivas, análise rápida de grande quantidade de dados, aumento da produtividade, entre outros.

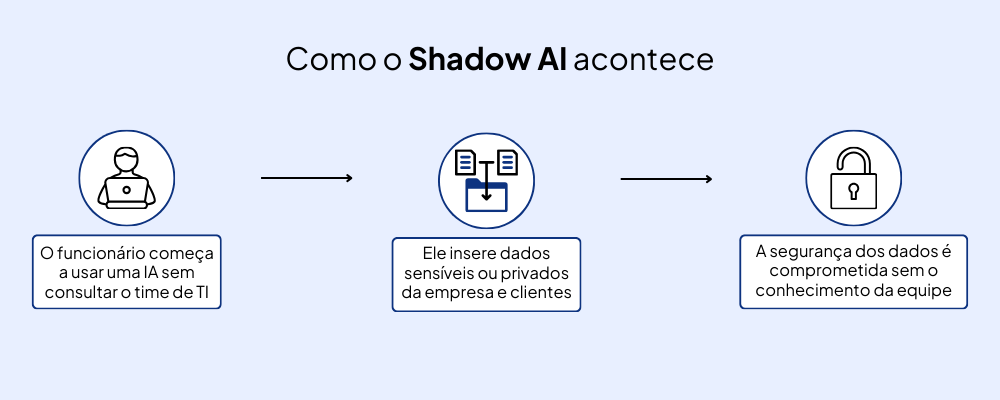

Porém, devido a um contexto que exige velocidade, muitas organizações acabam sofrendo com o uso de IAs não autorizadas dentro do seu ecossistema, levando ao Shadow AI.

Esse termo se refere ao uso de ferramentas de IA sem o conhecimento ou autorização do time de TI.

Neste artigo, falaremos sobre o que é Shadow AI, os riscos que ele representa e quais são as melhores práticas para uma gestão segura da IA.

O que é Shadow AI?

Esse termo representa o uso de qualquer tipo de ferramenta de inteligência artificial pelos funcionários sem que essa tenha sido aprovada formalmente pelo TI.

Geralmente isso acontece por falta de diretrizes e políticas claras sobre a adoção de novas ferramentas.

Shadow AI x Shadow IT: qual é a diferença?

Você talvez já tenha ouvido o termo Shadow IT. Esse termo é bastante similar ao Shadow AI, porém ele representa o uso não autorizado de qualquer tipo de software ou hardware.

Já o Shadow AI refere-se especificamente às ferramentas de IA, uma vez que elas trazem implicações mais específicas.

Exemplos

O Shadow AI ocorre diariamente em muitas empresas.

Um exemplo frequente é o uso de ferramentas como ChatGPT, Gemini e Copilot para análise de dados, sem tomar o cuidado de verificar se as informações são sensíveis ou confidenciais.

Outro exemplo é a automatização de determinadas tarefas com IA generativa, sem que isso seja devidamente autorizado.

Mais abaixo falaremos sobre as possíveis consequências dessas situações.

Por que isso é uma ameaça?

Como mencionado anteriormente, o Shadow AI traz o seu próprio conjunto de ameaças e particularidades. Vamos analisar as principais delas.

Vazamento de dados e propriedade intelectual

A maioria das ferramentas de IA processam e armazenam os dados inseridos em nuvem. Isso significa que todas as informações enviadas ficam registradas ali.

Dessa forma, os dados sensíveis, de clientes ou da própria empresa, enviados para a IA ficam comprometidos e suscetíveis a vazamentos e plágio.

Problemas de governança

Quando o Shadow AI ocorre, as ferramentas estão totalmente fora do controle do TI. Dessa forma, não é possível realizar auditorias confiáveis, trazendo problemas com regulamentações e normas de compliance, como a própria LGPD.

Prejuízos à reputação

O uso inadequado de ferramentas de IA pode gerar falhas na operação da empresa e, principalmente, causar uma exposição negativa da marca, prejudicando sua relação com clientes, investidores, parceiros e fornecedores.

Como identificar Shadow AI na empresa?

Existem várias maneiras de identificar se o Shadow AI está acontecendo na sua empresa. As principais delas são:

- Analisar se está ocorrendo o acesso frequente a determinadas ferramentas de IA nas redes da organização.

- Realizar auditorias internas para investigar quais ferramentas estão sendo utilizadas sem autorização.

- Abrir um espaço para diálogo com a equipe a respeito do uso de IA.

Como prevenir o Shadow AI?

Prevenir o Shadow AI envolve um alto nível de envolvimento e proatividade da organização. Algumas práticas que devem ser implementadas são:

- Políticas de aquisição e uso de IA: estabelecer diretrizes sobre o uso dessas ferramentas, especificando quais estão autorizadas, com quais tipos de dados e para quais finalidades.

- Treinamento da equipe: treinar, de forma periódica, os times sobre os riscos do Shadow AI e as responsabilidades de cada um na proteção de dados e uso correto das ferramentas.

- Governança de IA: criar grupos multidisciplinares para acompanhar os avanços e o uso de IA no meio corporativo, garantindo uma adoção segura e alinhada aos objetivos da empresa.

FAQ sobre Shadow AI

1. O que é Shadow AI em palavras simples?

É o uso de ferramentas de IA sem conhecimento ou aprovação da TI.

2. Quais são as consequências do Shadow AI?

Pode infringir leis como a LGPD, prejudicar a adequação a compliance, comprometer a segurança de dados e gerar danos à reputação da empresa.

3. Como evitar o Shadow AI?

Com políticas claras, educação da equipe e realizando o monitoramento de uso.

4. Toda ferramenta IA generativa traz risco para as empresas?

Não, desde que o uso seja regulamentado, seguro e controlado.

A Vantico ajuda você a mapear vulnerabilidades ligadas à Inteligência Artificial e Modelos de Linguagem Ampla (LLM)! Com mais de 4 anos de mercado e centenas de clientes satisfeitos, nosso pentest é orientado à compliance, além de contarmos com uma plataforma completa em serviços de segurança cibernética.

Clique aqui para conhecer nosso trabalho com Pentest LLM.

Siga a Vantico nas redes sociais e fique informado sobre cibersegurança, tecnologia e insights.